广州市黄埔区联和街道科丰路266号归谷科技园C3栋17楼

工控机与Docker容器化:工业应用的轻量化部署实战

当传统虚拟化还在为资源占用发愁时,Docker容器化已经悄然走进了工业现场。更轻的负载、更快的启动、更强的可移植性——工控机拥抱容器化,不只是技术升级,更是运维思维的革新。本文从实战出发,带你玩转工控场景的容器化部署。

一、核心价值:为什么工控机需要容器化?

工业现场的运维痛点,Docker能解几个?答案可能比你想象的多。

1.1 传统虚拟化的重负担,工控机扛不住

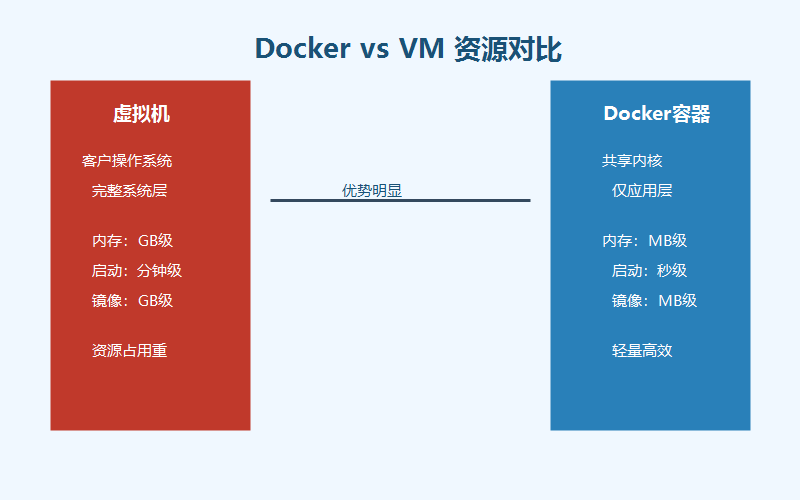

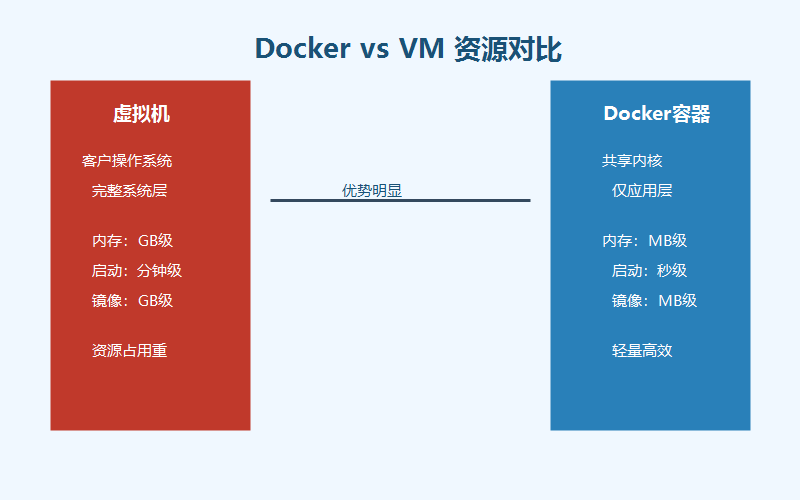

传统虚拟机(VM)需要完整的操作系统 Guest OS,动辄占用数GB内存、几十GB存储。工控机资源本就有限,一台工控机跑两三个VM就捉襟见肘。而Docker容器共享宿主机内核,容器本身仅包含应用及其依赖,镜像通常只有几百MB,内存占用可降至MB级别。

对比维度:内存占用(VM: GB级 vs 容器: MB级)、启动时间(VM: 分钟级 vs 容器: 秒级)、镜像大小(VM: GB级 vs 容器: MB级)。资源利用率的差异,直接决定了一台工控机能承载多少业务应用。

1.2 开发与生产环境的一致性困扰

传统工控软件开发中,“我这儿能跑,你那儿不行”是常见问题。开发环境、测试环境、生产环境的软件版本、依赖库、配置参数往往存在差异,导致应用迁移后频频报错。Docker通过镜像机制封装了应用及其完整运行环境,确保“一次构建,到处运行”,彻底消除环境差异导致的部署问题。

1.3 工控应用升级的高风险操作

工控现场的应用升级向来是个高风险操作。停机时间长、回滚困难、依赖冲突频发,稍有不慎就影响生产。Docker容器的版本化管理让每次升级都变成镜像切换,出问题秒级回滚,极大降低了运维风险。同时,多版本容器可并存,蓝绿部署、灰度发布在工控现场也能轻松实现。

二、技术架构:工控容器化的实现路径

从单机容器到边缘集群,工控场景的容器化落地有其独特的技术选型逻辑。

2.1 单机Docker部署:入门首选

对于单台工控机承载多个独立应用的场景,直接部署Docker Engine即可满足需求。工控机安装Linux系统(推荐Ubuntu、Debian或CentOS),通过官方脚本或包管理器安装Docker,随后即可通过docker run命令启动容器。

典型部署模式包括:边缘网关容器(采集PLC数据并上云)、视觉检测容器(运行AI推理模型)、数据采集容器(对接Modbus/OPC UA协议)、Web服务容器(提供本地监控界面)。每个容器独立运行,互不干扰,资源通过cgroups隔离。

2.2 Docker Compose:多容器编排利器

当工控应用由多个协作容器组成(如数据库+后端+前端),Docker Compose提供了简洁的编排方式。通过docker-compose.yml文件定义服务拓扑、网络配置、数据卷挂载,一键启动整个应用栈。配置文件可版本化管理,确保环境可复现。

典型应用场景:工业数据平台(InfluxDB+Grafana+数据采集器)、MES系统微服务拆分、本地AI推理服务栈(模型服务+API网关+日志收集)。

2.3 Kubernetes边缘部署:进阶路线

当工控现场存在多台工控机需要协同,或需要云边协同能力时,Kubernetes(K8s)及其边缘衍生版本成为选择。K3s、MicroK8s等轻量级K8s发行版专为边缘场景优化,单节点内存占用可控制在512MB以内,适配资源受限的工控机环境。

K8s边缘部署的核心价值:跨节点调度(应用在多台工控机间自动迁移)、自愈能力(容器崩溃后自动重启)、滚动更新(零停机升级)、云边协同(云端下发配置,边缘侧执行)。但也需注意,K8s引入了更高的运维复杂度,需评估团队技术能力。

三、典型应用场景:工控容器化实战案例

从边缘网关到AI推理,容器化正在重塑工控应用的部署范式。

3.1 边缘网关:数据采集与协议转换

工业边缘网关是容器化的典型场景。传统网关软件功能固化,升级困难。容器化后,协议转换器(Modbus转MQTT、OPC UA转HTTP)、数据清洗模块、边缘计算逻辑各自独立成容器,按需组合部署。当需要新增协议支持时,只需拉取新镜像,无需重构整个网关系统。

3.2 AI推理:工控机的智能大脑

随着工控机承载越来越多的AI任务,容器化成为模型管理的最佳实践。每个AI模型打包为独立容器,包含推理引擎(TensorFlow Lite、ONNX Runtime)、依赖库、配置文件。工控机可同时运行多个模型容器(缺陷检测、设备预测性维护、安全行为识别),互不干扰,资源按需分配。

当模型需要更新时,只需替换容器镜像,无需重新配置环境。同时,模型容器的资源限制(CPU/内存/GPU份额)可精细控制,避免某个模型独占资源影响其他业务。

3.3 工业APP:云边协同新生态

工业APP生态的兴起,让工控机成为运行各类工业软件的载体。容器化为工业APP的快速部署、版本管理、隔离运行提供了标准化的技术底座。云端APP商店一键下发,边缘侧工控机自动拉取镜像并启动容器,实现即点即用的应用体验。

典型应用:能耗分析APP、设备运维APP、质量追溯APP。每个APP作为独立容器运行,数据通过共享存储或消息队列交互,既保证了隔离性,又支持灵活组合。

四、避坑指南:工控容器化的实战经验

容器化不是万能药,工控场景的特殊性决定了落地过程需要因地制宜。

4.1 实时性考量:容器能扛得住吗?

工控场景对实时性要求严苛,而Docker容器的性能开销虽低,但并非零开销。容器层增加了网络栈、文件系统抽象,对硬实时场景(周期≤1ms)仍有影响。建议:非硬实时任务(数据采集、协议转换、业务逻辑)优先容器化;硬实时任务(运动控制、高速采集)仍采用裸机或RTOS方案。

4.2 存储持久化:数据别丢在容器里

容器的设计理念是无状态,而工业应用往往需要持久化存储(历史数据、配置文件、日志)。解决方案:使用Docker Volume或Bind Mount将关键数据映射到宿主机目录,确保容器销毁后数据不丢失。同时,生产环境建议将数据库等有状态服务部署在独立存储或专用服务器上,而非容器内。

4.3 网络配置:容器间通信与外部访问

工控网络环境复杂,存在多网段、VLAN隔离、工业协议专用端口等约束。容器默认的桥接网络可能与现场网络规划冲突。建议:采用Host网络模式让容器直接使用宿主机网络栈,或通过Macvlan为容器分配独立IP地址,确保与PLC、SCADA等设备的网络可达性。

4.4 安全隔离:别让一个容器炸了全家

容器虽然隔离了应用,但共享内核意味着安全边界并非绝对。一个容器被攻破后,可能通过内核漏洞影响宿主机及其他容器。建议:为关键容器设置资源限额(CPU、内存、PID数),使用只读文件系统减少攻击面,启用User Namespace隔离,定期更新宿主机内核及Docker版本。

4.5 运维体系:容器化后的新挑战

容器化后,运维对象从应用变成了容器+镜像+编排配置。需要建立新的运维能力:镜像仓库管理(私有仓库搭建、镜像扫描、版本标签规范)、日志采集(容器日志输出到ELK/Loki)、监控体系(Prometheus采集容器指标)、故障排查(掌握docker logs、docker exec等命令)。工控团队需要补充容器化运维技能。

五、总结:容器化是手段,不是目的

Docker容器化为工控机带来了轻量化部署、环境一致性、快速迭代的能力,但并非所有场景都适合容器化。硬实时任务、强依赖特定硬件的应用、极度资源受限的嵌入式设备,容器化的收益有限甚至得不偿失。合理的技术选型,才能让容器化真正为工业现场创造价值。

容器化的本质是运维思维的升级。从手动配置环境到代码定义环境,从停机升级到秒级回滚,从单机孤岛到云边协同——这才是工控容器化带来的真正变革。

当传统虚拟化还在为资源占用发愁时,Docker容器化已经悄然走进了工业现场。更轻的负载、更快的启动、更强的可移植性——工控机拥抱容器化,不只是技术升级,更是运维思维的革新。本文从实战出发,带你玩转工控场景的容器化部署。

一、核心价值:为什么工控机需要容器化?

工业现场的运维痛点,Docker能解几个?答案可能比你想象的多。

1.1 传统虚拟化的重负担,工控机扛不住

传统虚拟机(VM)需要完整的操作系统 Guest OS,动辄占用数GB内存、几十GB存储。工控机资源本就有限,一台工控机跑两三个VM就捉襟见肘。而Docker容器共享宿主机内核,容器本身仅包含应用及其依赖,镜像通常只有几百MB,内存占用可降至MB级别。

对比维度:内存占用(VM: GB级 vs 容器: MB级)、启动时间(VM: 分钟级 vs 容器: 秒级)、镜像大小(VM: GB级 vs 容器: MB级)。资源利用率的差异,直接决定了一台工控机能承载多少业务应用。

1.2 开发与生产环境的一致性困扰

传统工控软件开发中,“我这儿能跑,你那儿不行”是常见问题。开发环境、测试环境、生产环境的软件版本、依赖库、配置参数往往存在差异,导致应用迁移后频频报错。Docker通过镜像机制封装了应用及其完整运行环境,确保“一次构建,到处运行”,彻底消除环境差异导致的部署问题。

1.3 工控应用升级的高风险操作

工控现场的应用升级向来是个高风险操作。停机时间长、回滚困难、依赖冲突频发,稍有不慎就影响生产。Docker容器的版本化管理让每次升级都变成镜像切换,出问题秒级回滚,极大降低了运维风险。同时,多版本容器可并存,蓝绿部署、灰度发布在工控现场也能轻松实现。

二、技术架构:工控容器化的实现路径

从单机容器到边缘集群,工控场景的容器化落地有其独特的技术选型逻辑。

2.1 单机Docker部署:入门首选

对于单台工控机承载多个独立应用的场景,直接部署Docker Engine即可满足需求。工控机安装Linux系统(推荐Ubuntu、Debian或CentOS),通过官方脚本或包管理器安装Docker,随后即可通过docker run命令启动容器。

典型部署模式包括:边缘网关容器(采集PLC数据并上云)、视觉检测容器(运行AI推理模型)、数据采集容器(对接Modbus/OPC UA协议)、Web服务容器(提供本地监控界面)。每个容器独立运行,互不干扰,资源通过cgroups隔离。

2.2 Docker Compose:多容器编排利器

当工控应用由多个协作容器组成(如数据库+后端+前端),Docker Compose提供了简洁的编排方式。通过docker-compose.yml文件定义服务拓扑、网络配置、数据卷挂载,一键启动整个应用栈。配置文件可版本化管理,确保环境可复现。

典型应用场景:工业数据平台(InfluxDB+Grafana+数据采集器)、MES系统微服务拆分、本地AI推理服务栈(模型服务+API网关+日志收集)。

2.3 Kubernetes边缘部署:进阶路线

当工控现场存在多台工控机需要协同,或需要云边协同能力时,Kubernetes(K8s)及其边缘衍生版本成为选择。K3s、MicroK8s等轻量级K8s发行版专为边缘场景优化,单节点内存占用可控制在512MB以内,适配资源受限的工控机环境。

K8s边缘部署的核心价值:跨节点调度(应用在多台工控机间自动迁移)、自愈能力(容器崩溃后自动重启)、滚动更新(零停机升级)、云边协同(云端下发配置,边缘侧执行)。但也需注意,K8s引入了更高的运维复杂度,需评估团队技术能力。

三、典型应用场景:工控容器化实战案例

从边缘网关到AI推理,容器化正在重塑工控应用的部署范式。

3.1 边缘网关:数据采集与协议转换

工业边缘网关是容器化的典型场景。传统网关软件功能固化,升级困难。容器化后,协议转换器(Modbus转MQTT、OPC UA转HTTP)、数据清洗模块、边缘计算逻辑各自独立成容器,按需组合部署。当需要新增协议支持时,只需拉取新镜像,无需重构整个网关系统。

3.2 AI推理:工控机的智能大脑

随着工控机承载越来越多的AI任务,容器化成为模型管理的最佳实践。每个AI模型打包为独立容器,包含推理引擎(TensorFlow Lite、ONNX Runtime)、依赖库、配置文件。工控机可同时运行多个模型容器(缺陷检测、设备预测性维护、安全行为识别),互不干扰,资源按需分配。

当模型需要更新时,只需替换容器镜像,无需重新配置环境。同时,模型容器的资源限制(CPU/内存/GPU份额)可精细控制,避免某个模型独占资源影响其他业务。

3.3 工业APP:云边协同新生态

工业APP生态的兴起,让工控机成为运行各类工业软件的载体。容器化为工业APP的快速部署、版本管理、隔离运行提供了标准化的技术底座。云端APP商店一键下发,边缘侧工控机自动拉取镜像并启动容器,实现即点即用的应用体验。

典型应用:能耗分析APP、设备运维APP、质量追溯APP。每个APP作为独立容器运行,数据通过共享存储或消息队列交互,既保证了隔离性,又支持灵活组合。

四、避坑指南:工控容器化的实战经验

容器化不是万能药,工控场景的特殊性决定了落地过程需要因地制宜。

4.1 实时性考量:容器能扛得住吗?

工控场景对实时性要求严苛,而Docker容器的性能开销虽低,但并非零开销。容器层增加了网络栈、文件系统抽象,对硬实时场景(周期≤1ms)仍有影响。建议:非硬实时任务(数据采集、协议转换、业务逻辑)优先容器化;硬实时任务(运动控制、高速采集)仍采用裸机或RTOS方案。

4.2 存储持久化:数据别丢在容器里

容器的设计理念是无状态,而工业应用往往需要持久化存储(历史数据、配置文件、日志)。解决方案:使用Docker Volume或Bind Mount将关键数据映射到宿主机目录,确保容器销毁后数据不丢失。同时,生产环境建议将数据库等有状态服务部署在独立存储或专用服务器上,而非容器内。

4.3 网络配置:容器间通信与外部访问

工控网络环境复杂,存在多网段、VLAN隔离、工业协议专用端口等约束。容器默认的桥接网络可能与现场网络规划冲突。建议:采用Host网络模式让容器直接使用宿主机网络栈,或通过Macvlan为容器分配独立IP地址,确保与PLC、SCADA等设备的网络可达性。

4.4 安全隔离:别让一个容器炸了全家

容器虽然隔离了应用,但共享内核意味着安全边界并非绝对。一个容器被攻破后,可能通过内核漏洞影响宿主机及其他容器。建议:为关键容器设置资源限额(CPU、内存、PID数),使用只读文件系统减少攻击面,启用User Namespace隔离,定期更新宿主机内核及Docker版本。

4.5 运维体系:容器化后的新挑战

容器化后,运维对象从应用变成了容器+镜像+编排配置。需要建立新的运维能力:镜像仓库管理(私有仓库搭建、镜像扫描、版本标签规范)、日志采集(容器日志输出到ELK/Loki)、监控体系(Prometheus采集容器指标)、故障排查(掌握docker logs、docker exec等命令)。工控团队需要补充容器化运维技能。

五、总结:容器化是手段,不是目的

Docker容器化为工控机带来了轻量化部署、环境一致性、快速迭代的能力,但并非所有场景都适合容器化。硬实时任务、强依赖特定硬件的应用、极度资源受限的嵌入式设备,容器化的收益有限甚至得不偿失。合理的技术选型,才能让容器化真正为工业现场创造价值。

容器化的本质是运维思维的升级。从手动配置环境到代码定义环境,从停机升级到秒级回滚,从单机孤岛到云边协同——这才是工控容器化带来的真正变革。

售前电话:4008-616-216售前邮箱:sales@hwsys.cn

售后电话:4008-616-216售后邮箱:support@hwsys.cn

- 产品服务模块化工控机嵌入式工控机服务器/工作站标准主板AI人工智能计算模组工业平板电脑软件系统定制服务

- 解决方案矿山电力交通石化轨交储能水务机器人智能制造

- 服务与支持资料下载维修申请问题反馈

- 关于汉为公司介绍发展历程企业荣誉技术创新核心优势合作伙伴联系我们